當 AI 遇上材料化學:研究生如何不被「看起來很厲害」的論文誤導?

一、從一篇「轟動全球」的論文說起

2023 年 11 月,Google DeepMind 在《Nature》期刊發表了一篇引發廣泛討論的研究(Merchant et al., 2023)。該論文描述了一套以圖神經網路(Graph Neural Networks)大規模訓練的模型 GNoME(Graph Networks for Materials Exploration),宣稱發現了 220 萬種晶體結構,其中約 38.1 萬種為新穩定材料,代表人類已知穩定材料數量的數量級擴張。媒體報導鋪天蓋地,甚至將其稱為「等同 800 年的知識積累」。研究生看到這樣的標題,很自然地會產生一種印象:這個領域是否即將被 AI 顛覆?

然而,故事並未就此結束。

來自加州大學聖塔芭芭拉分校的材料科學家 Anthony K. Cheetham 與 Ram Seshadri 在《Chemistry of Materials》發表評析(Cheetham & Seshadri, 2024),指出該研究鮮有證據顯示其提出的化合物能同時滿足新穎性(novelty)、可信度(credibility)與實用性(utility)三項標準,並強調仍需更多材料合成與晶體學的專業介入。

這引出本文的核心問題:當一篇發表於頂尖期刊的論文聲稱重大突破時,我們應如何閱讀與判斷,而非照單全收?

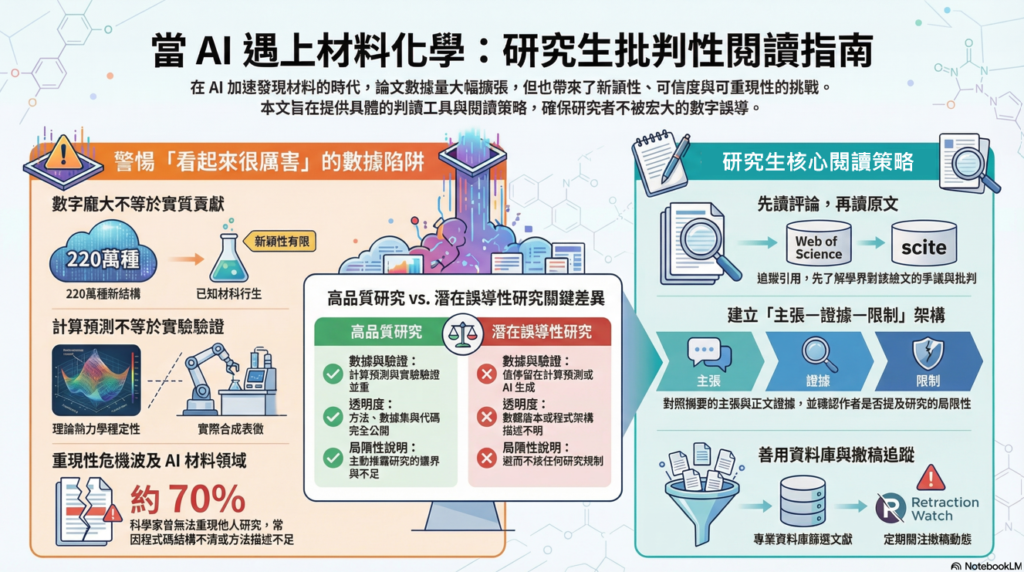

二、「看起來很厲害」的幾種常見模式

2.1 數字越大,越要小心

GNoME 的案例提醒我們:宏大的數字不等於宏大的貢獻。批評者指出,其資料庫中許多「新材料」實際上為已知材料的衍生或延伸,例如大量屬於既有硼化物體系的結構。這些結構在計算上或許合理,但在新穎性上未必具有突破性。

因此,當我們讀到「發現X萬種新材料」時,應追問:「新」的定義為何?是計算上的熱力學穩定性,還是已經完成實驗合成與驗證?兩者意義差異甚大。

2.2 計算預測 ≠ 實驗驗證

近年研究顯示,生成式 AI 能產生與真實資料極為相似的科學影像,甚至連專家也難以可靠分辨(Hartung et al., 2024)。同時,AI 也能快速生成資料處理程式碼,但其中可能包含違反基本物理原則的錯誤,而這些問題常常無法在同儕審查中被立即察覺(Reeves-McLaren & Moth-Lund Christensen, 2026)。

這並非否定計算材料學的價值,而是提醒研究者:閱讀論文時必須區分「計算預測」與「實驗實證」。一篇宣稱「發現」材料的研究,究竟停留於理論預測,或已完成合成與表徵,其學術意義截然不同。

2.3 可重現性危機已波及材料化學

一項由《Nature》進行的調查指出,約 70% 的科學家曾無法成功重現他人的研究結果(Baker, 2016)。此現象並非材料化學所獨有,但在 AI 驅動的高通量研究中尤為顯著。

進一步研究顯示,在材料資訊學領域中,重現性困難常來自於:軟體依賴未說明、版本控制不足、程式碼結構不清,以及論文描述不完整(Persaud et al., 2024)。

這意味著,即使是發表於高影響力期刊的研究,也可能因方法描述不足而難以驗證。因此,讀者應主動思考:這項研究是否具備可重現性?

三、研究生的四大閱讀策略

策略一:先讀批評,再讀原文

這是反直覺但非常有效的閱讀順序。透過引用追蹤,找到針對一篇論文的後續評論、回應或批判性評析,先了解爭議所在,再回頭閱讀原文,往往能更快抓住關鍵問題。

以 GNoME 為例,除了原論文(Merchant et al., 2023)之外,Cheetham 與 Seshadri 在《Chemistry of Materials》發表了題為〈Artificial Intelligence Driving Materials Discovery? Perspective on the Article: Scaling Deep Learning for Materials Discovery〉的評析(Cheetham & Seshadri, 2024),系統性討論該研究在新穎性、可信度與實用性之間的落差。這篇評析是理解 GNoME 爭議不可錯過的對照讀物。

圖書館資源提示: 使用 Web of Science 或 Scite 資料庫,可以快速找到引用某篇論文的後續文獻,包括批評性評析與回應文章。

策略二:建立「主張—證據—限制」架構

每次閱讀一篇材料化學論文,不妨在筆記中明確區分三個層次:

主張(Claim) 是什麼?論文聲稱發現了什麼、達到了什麼性能、解決了什麼問題。注意摘要和標題往往是最「行銷化」的部分,需要和正文對照。

證據(Evidence) 是什麼形式的?是計算預測、理論模擬,還是實驗數據?使用了哪些表徵技術?樣本數量是否足夠?控制組設計是否合理?

限制(Limitation) 作者自己說了什麼?許多高品質論文會在Discussion或末尾主動說明研究的局限性。若一篇論文完全沒有提及任何限制,反而值得提高警覺。

策略三:善用資料庫篩選

優先使用如 Web of Science、Scopus 與 SciFinder等資料庫,以確保文獻品質,並謹慎使用未經同儕審查的預印本。

策略四:追蹤撤稿動態

近年材料科學領域亦出現多起撤稿事件。以《Nature》曾刊登的摻氮氫化鑥超導研究為例,其後被標記為「撤稿文章(RETRACTED ARTICLE),成為研究誠信的重要案例。

定期關注 Retraction Watch 平台,該平台持續追蹤學術論文撤稿事件,並提供相關背景與分析有助於建立資訊判讀能力。

四、生成式 AI 的應用:工具,而非替代判斷

生成式 AI(如 ChatGPT、Claude、Gemini)已廣泛進入研究過程。

研究者可將其用於文獻整理、語言潤飾與程式輔助,但仍需遵守揭露原則,並避免將判斷工作外包。

核心原則在於:AI 可以輔助研究,但不能取代批判性思考。

五、好的材料化學研究,長什麼樣子?

批判不等於否定。我們需要學會識別不可靠的研究,同樣也需要知道,值得信賴的研究通常具備哪些特徵。

現有 AI 材料科學綜述指出,資料品質(data quality)與可重現性(reproducibility)是影響研究可靠性的關鍵挑戰之一(Osaro et al., 2025)。

優質研究通常具備:方法論描述詳盡透明、數據集與代碼公開可取用、承認研究的侷限性、與既有文獻有清晰的對話,以及計算預測有對應的實驗驗證。

六、結語

在 AI 加速科學發現的時代,材料化學研究正以前所未有的速度擴展。然而,資訊的增加並不必然等於知識的累積。

對研究生而言,關鍵不在於是否相信論文,而在於是否具備判斷依據。透過批判性閱讀,我們才能在資訊洪流中維持清晰的學術判斷。

最終,AI 不會取代研究者,但會放大研究者的判斷力。批判性閱讀,正是建立學術立場與參與知識生產的基礎能力。

📚 References

Baker, M. (2016). 1,500 scientists lift the lid on reproducibility. Nature, 533(7604), 452–454. https://doi.org/10.1038/533452a

Cheetham, A. K., & Seshadri, R. (2024). Artificial intelligence driving materials discovery? Perspective on the article: Scaling deep learning for materials discovery. Chemistry of Materials, 36(8), 3490–3495. https://doi.org/10.1021/acs.chemmater.4c00643

Hartung, J., Reuter, S., Kulow, V. A., Fähling, M., Spreckelsen, C., & Mrowka, R. (2024). Experts fail to reliably detect AI-generated histological data. Scientific Reports, 14, Article 28677. https://doi.org/10.1038/s41598-024-73913-8

Merchant, A., Batzner, S., Schoenholz, S. S., Aykol, M., Cheon, G., & Cubuk, E. D. (2023). Scaling deep learning for materials discovery. Nature, 624(7990), 80–85. https://doi.org/10.1038/s41586-023-06735-9

Osaro, E., Karpinski, N., Alornyo, S., & Ighalo, J. O. (2025). Artificial intelligence in chemistry and materials science: Current applications and future directions. Materials Today Chemistry, 49, Article 103115. https://doi.org/10.1016/j.mtchem.2025.103115

Persaud, D., Ward, L., & Hattrick-Simpers, J. (2024). Reproducibility in materials informatics: Lessons from a general-purpose machine learning framework. Digital Discovery, 3, 281–290. https://doi.org/10.1039/D3DD00199G

Reeves-McLaren, N., & Moth-Lund Christensen, S. (2026). Data integrity in materials science in the era of AI: Balancing accelerated discovery with responsible science and innovation. Journal of Materials Chemistry A, 14, 276–283. https://doi.org/10.1039/D5TA05512A

推廣組 巫惠屏 / 本文搭配AI工具進行寫作輔助